Ez az útmutató bemutatja a beszélgetési összefoglaló használatának folyamatát a LangChainben.

Hogyan kell használni a beszélgetési összefoglalót a LangChainben?

A LangChain olyan könyvtárakat biztosít, mint a ConversationSummaryMemory, amelyek kivonhatják a csevegés vagy beszélgetés teljes összefoglalóját. Használható a beszélgetés főbb információihoz anélkül, hogy el kellene olvasnia a chatben elérhető összes üzenetet és szöveget.

Ha meg szeretné tanulni a beszélgetési összefoglaló használatának folyamatát a LangChainben, egyszerűen hajtsa végre a következő lépéseket:

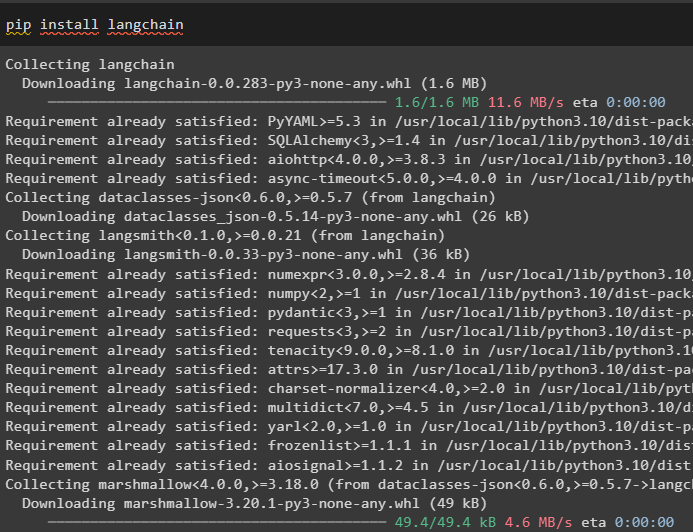

1. lépés: Modulok telepítése

Először telepítse a LangChain keretrendszert a függőségek vagy könyvtárak lekéréséhez a következő kód segítségével:

pip install langchain

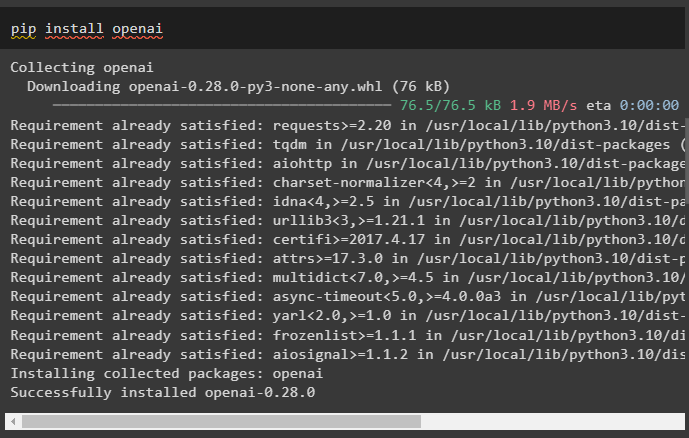

Most telepítse az OpenAI modulokat a LangChain telepítése után a pip paranccsal:

pip install openai

A modulok telepítése után egyszerűen állítsa be a környezetet a következő kód használatával, miután megkapta az API-kulcsot az OpenAI-fiókból:

import teimport getpass

te . hozzávetőlegesen, körülbelül [ 'OPENAI_API_KEY' ] = getpass . getpass ( 'OpenAI API kulcs:' )

2. lépés: A Beszélgetés összegzése használata

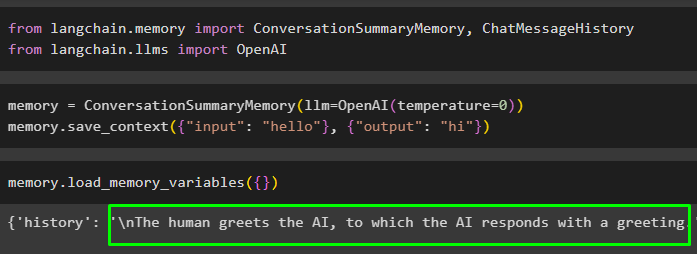

Lépjen be a beszélgetési összefoglaló használatába a könyvtárak LangChainből történő importálásával:

tól től langchain. memória import ConversationSummaryMemory , ChatMessageHistorytól től langchain. llms import OpenAI

Konfigurálja a modell memóriáját a ConversationSummaryMemory() és OpenAI() metódusokkal, és mentse el benne az adatokat:

memória = ConversationSummaryMemory ( llm = OpenAI ( hőfok = 0 ) )memória. save_context ( { 'bemenet' : 'Helló' } , { 'Kimenet' : 'Szia' } )

Futtassa a memóriát a load_memory_variables() módszer az adatok kinyerésére a memóriából:

memória. load_memory_variables ( { } )

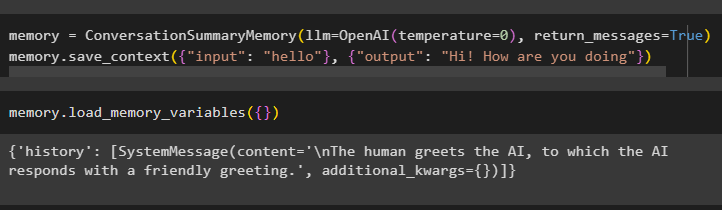

A felhasználó beszélgetés formájában is megkaphatja az adatokat, mint minden entitás külön üzenettel:

memória = ConversationSummaryMemory ( llm = OpenAI ( hőfok = 0 ) , return_messages = Igaz )memória. save_context ( { 'bemenet' : 'Helló' } , { 'Kimenet' : 'Szia, hogy vagy' } )

Ha külön szeretné megkapni az AI és az emberek üzenetét, hajtsa végre a load_memory_variables() metódust:

memória. load_memory_variables ( { } )

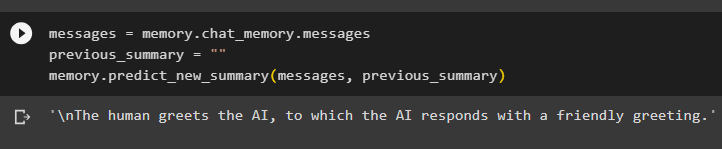

Tárolja a beszélgetés összefoglalóját a memóriában, majd hajtsa végre a memóriát, hogy a csevegés/beszélgetés összefoglalója megjelenjen a képernyőn:

üzenetek = memória. chat_memory . üzenetekelőző_összefoglaló = ''

memória. előre_új_összefoglaló ( üzenetek , előző_összefoglaló )

3. lépés: A beszélgetés összegzése a meglévő üzenetekkel

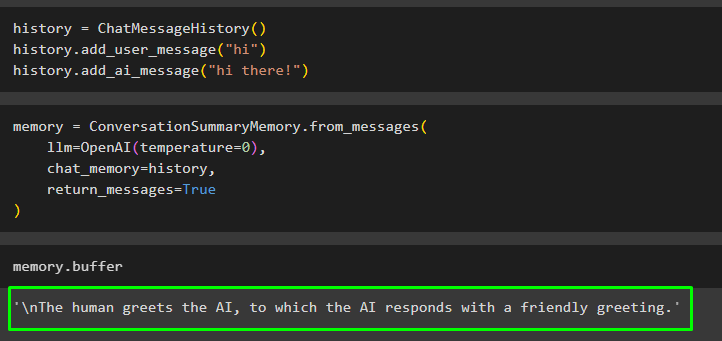

A felhasználó a ChatMessageHistory() üzenet segítségével is megkaphatja az osztályon vagy csevegésen kívüli beszélgetés összefoglalóját. Ezek az üzenetek hozzáadhatók a memóriához, így az automatikusan generálja a teljes beszélgetés összefoglalóját:

történelem = ChatMessageHistory ( )történelem. add_user_message ( 'Szia' )

történelem. add_ai_message ( 'Szia!' )

Készítse el a modellt, például az LLM-et az OpenAI() metódussal a meglévő üzenetek végrehajtásához chat_memory változó:

memória = ConversationSummaryMemory. from_messages (llm = OpenAI ( hőfok = 0 ) ,

chat_memory = történelem ,

return_messages = Igaz

)

Futtassa le a memóriát a puffer használatával, hogy megkapja a meglévő üzenetek összegzését:

memória. puffer

Futtassa a következő kódot az LLM felépítéséhez a puffermemória csevegési üzenetekkel történő konfigurálásával:

memória = ConversationSummaryMemory (llm = OpenAI ( hőfok = 0 ) ,

puffer = '''Az ember megkérdezi magáról a kérdező gépet

A rendszer azt válaszolja, hogy a mesterséges intelligencia jóra épül, mivel segíthet az embereknek kiaknázni a benne rejlő lehetőségeket''' ,

chat_memory = történelem ,

return_messages = Igaz

)

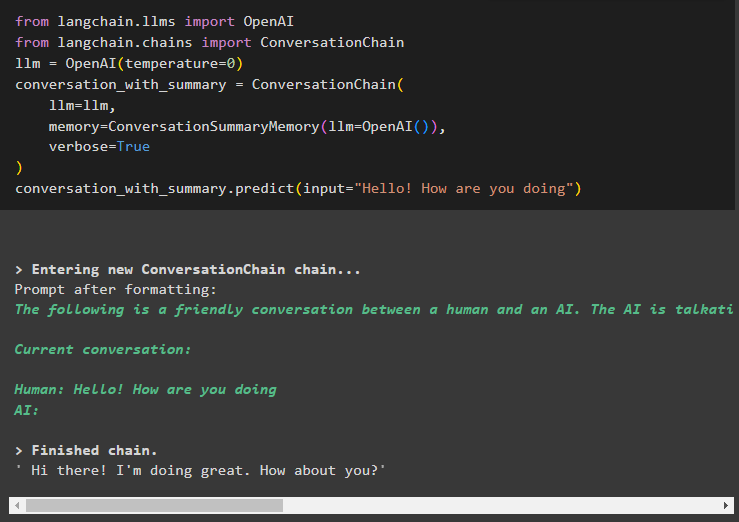

4. lépés: A beszélgetési összefoglaló használata a láncban

A következő lépés elmagyarázza a beszélgetés összefoglalójának láncban történő használatát az LLM segítségével:

tól től langchain. llms import OpenAItól től langchain. láncok import Beszélgetési lánc

llm = OpenAI ( hőfok = 0 )

beszélgetés_összefoglalóval = Beszélgetési lánc (

llm = llm ,

memória = ConversationSummaryMemory ( llm = OpenAI ( ) ) ,

bőbeszédű = Igaz

)

beszélgetés_összefoglalóval. megjósolni ( bemenet = 'Szia, hogy vagy' )

Itt elkezdtük a láncok építését azzal, hogy egy udvarias érdeklődéssel kezdtük a beszélgetést:

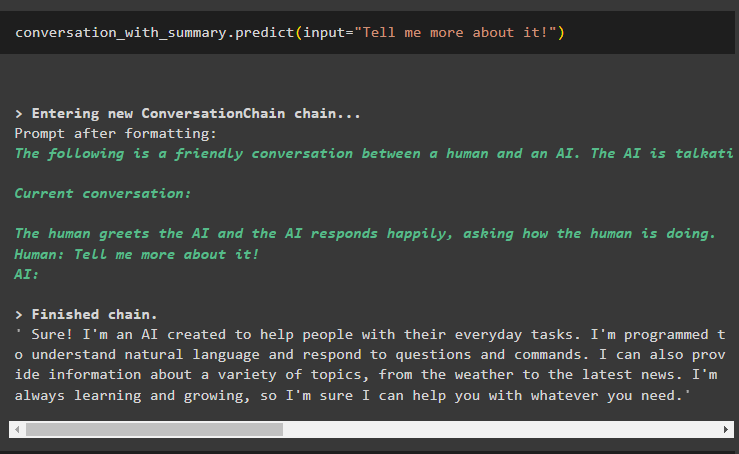

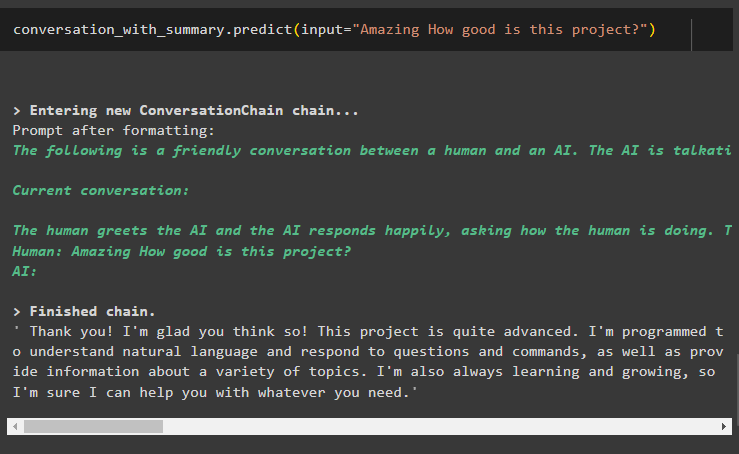

Most kezdjen bele a beszélgetésbe úgy, hogy egy kicsit többet kérdez az utolsó kimenetről, hogy kibővítse azt:

beszélgetés_összefoglalóval. megjósolni ( bemenet = 'Mesélj még erről többet!' )A modell az utolsó üzenetet az AI technológia vagy chatbot részletes bemutatásával magyarázta:

Vonjon ki egy érdekes pontot az előző kimenetből, hogy a beszélgetést egy adott irányba terelje:

beszélgetés_összefoglalóval. megjósolni ( bemenet = 'Elképesztő Mennyire jó ez a projekt?' )Itt részletes válaszokat kapunk a bottól a beszélgetés-összefoglaló memóriakönyvtár segítségével:

Ez minden a LangChain beszélgetés-összefoglalójának használatáról szól.

Következtetés

A beszélgetés összefoglaló üzenetének használatához a LangChainben egyszerűen telepítse a környezet beállításához szükséges modulokat és keretrendszereket. A környezet beállítása után importálja a ConversationSummaryMemory könyvtár LLM-ek létrehozásához az OpenAI() metódussal. Ezt követően egyszerűen használja a beszélgetés összefoglalóját, hogy kivonja a részletes kimenetet a modellekből, amely az előző beszélgetés összefoglalása. Ez az útmutató részletesen ismerteti a beszélgetés-összefoglaló memória használatának folyamatát a LangChain modul használatával.