Ez az útmutató bemutatja a beszélgetés-összefoglaló puffer használatának folyamatát a LangChainben.

Hogyan kell használni a beszélgetés-összefoglaló puffert a LangChainben?

A beszélgetés több üzenetet is tartalmazhat, amelyek olyanok, mint az ember és a gép közötti interakció, és a puffer tárolhatja a legfrissebb üzeneteket. A ConversationSummaryBufferMemory A könyvtár a két fogalom kombinálására szolgál, például a legfrissebb üzenetek tárolására és az összefoglaló kinyerésére.

A beszélgetés-összefoglaló puffer használatának folyamatának megismeréséhez a LangChainben egyszerűen kövesse az alábbi útmutatót:

1. lépés: Modulok telepítése

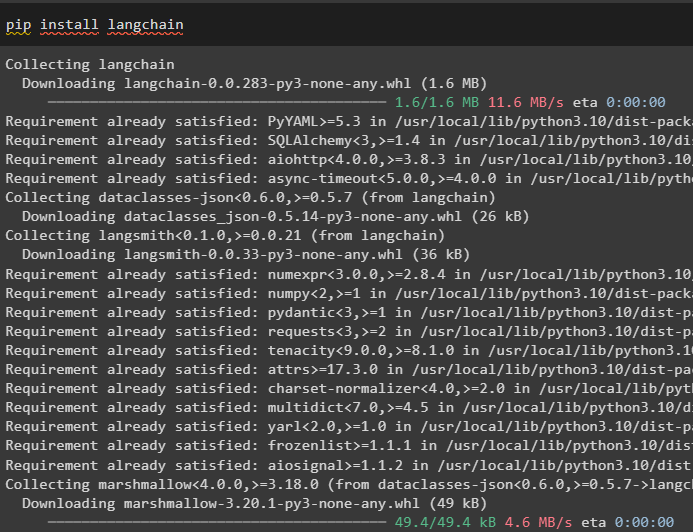

Először telepítse a LangChain modult a pip paranccsal, hogy megkapja a szükséges könyvtárakat:

pip install langchain

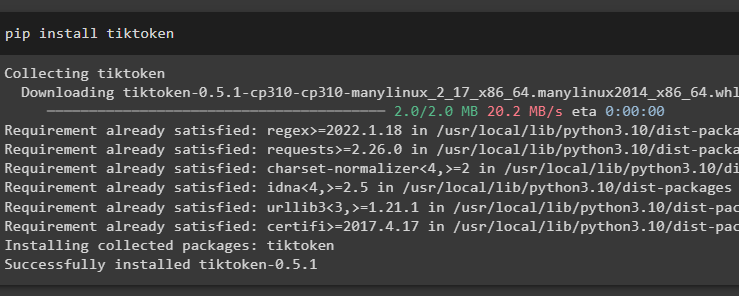

Telepítse a tiktoken tokenizert, amellyel a szöveges dokumentumokat kis darabokra oszthatja:

pip install tiktoken

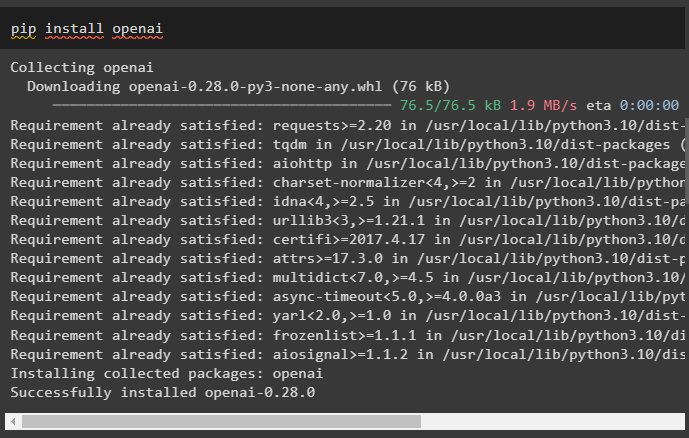

Ezután telepítse az OpenAI modulokat, amelyek segítségével nyelvi modelleket, például LLM-eket és láncokat hozhat létre:

pip install openai

Most, állítsa be a környezetet az API-kulcs beszerzésével az OpenAI-fiókból és a modellben való felhasználásával:

import teimport getpass

te . hozzávetőlegesen, körülbelül [ 'OPENAI_API_KEY' ] = getpass . getpass ( 'OpenAI API kulcs:' )

2. lépés: Beszélgetés-összefoglaló puffer használata

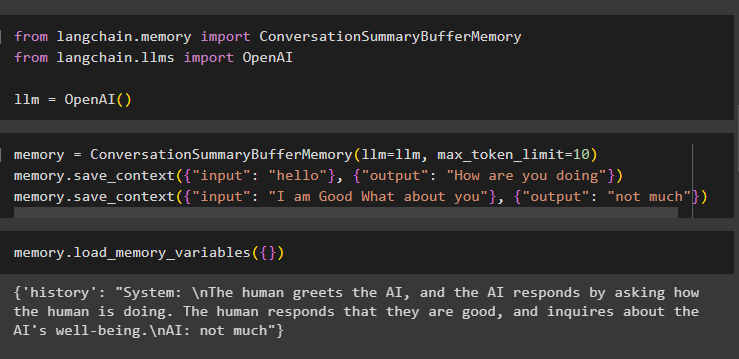

Indítsa el a beszélgetés-összefoglaló puffer használatának folyamatát a könyvtárak importálásával az LLM OpenAI() metódussal történő felépítéséhez:

tól től langchain. memória import ConversationSummaryBufferMemorytól től langchain. llms import OpenAI

llm = OpenAI ( )

Építse fel a memóriát a ConversationSummaryBufferMemory() metódussal, majd tárolja a beszélgetést a memóriában:

memória = ConversationSummaryBufferMemory ( llm = llm , max_token_limit = 10 )memória. save_context ( { 'bemenet' : 'Helló' } , { 'Kimenet' : 'Hogy vagy' } )

memória. save_context ( { 'bemenet' : 'Jó vagyok, mi van veled' } , { 'Kimenet' : 'nem sok' } )

Most futtassa a memóriát a load_memory_variables () módszer az üzenetek kinyerésére a memóriából:

memória. load_memory_variables ( { } )

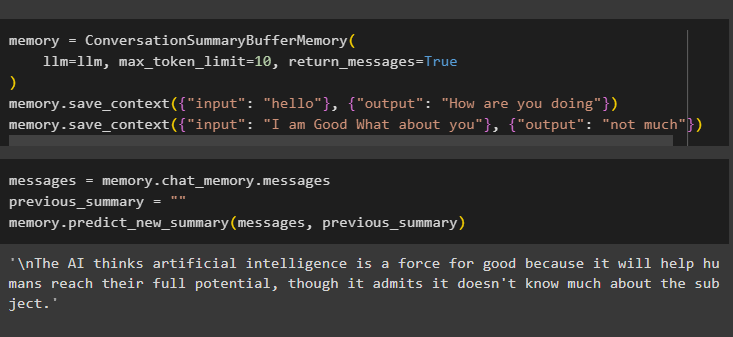

Most használja a beszélgetés pufferösszefoglalóját a puffer konfigurálásához a pufferben tárolandó üzenetek számának korlátozásával. Ezután bontsa ki a pufferben tárolt üzenetek összegzését, majd tárolja a beszélgetést a memóriában:

memória = ConversationSummaryBufferMemory (llm = llm , max_token_limit = 10 , return_messages = Igaz

)

memória. save_context ( { 'bemenet' : 'Helló' } , { 'Kimenet' : 'Hogy vagy' } )

memória. save_context ( { 'bemenet' : 'Jó vagyok, mi van veled' } , { 'Kimenet' : 'nem sok' } )

A puffermemóriában tárolt korábbi üzenetek összegzése a következő kóddal:

üzenetek = memória. chat_memory . üzenetekelőző_összefoglaló = ''

memória. előre_új_összefoglaló ( üzenetek , előző_összefoglaló )

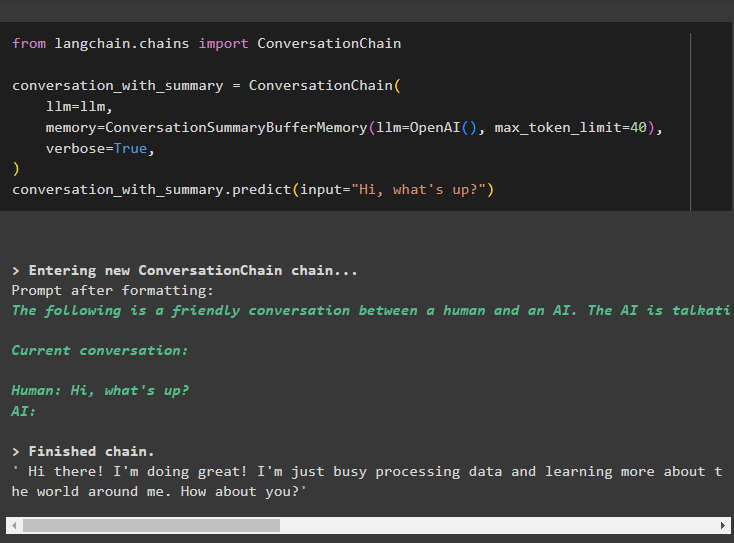

3. lépés: Beszélgetés-összefoglaló puffer használata láncban

Építse fel a láncokat a Beszélgetési lánc() metódus, amely tartalmazza a puffermemória értékét az üzenet tárolására:

tól től langchain. láncok import Beszélgetési láncbeszélgetés_összefoglalóval = Beszélgetési lánc (

llm = llm ,

memória = ConversationSummaryBufferMemory ( llm = OpenAI ( ) , max_token_limit = 40 ) ,

bőbeszédű = Igaz ,

)

beszélgetés_összefoglalóval. megjósolni ( bemenet = 'Szia mi újság?' )

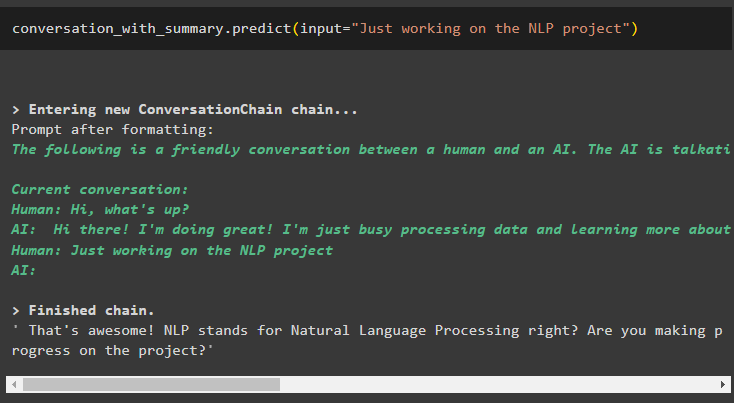

Adja meg a bemenetet szöveg formájában a predikció() metódussal, hogy megkapja a beszélgetés összefoglalóját:

beszélgetés_összefoglalóval. megjósolni ( bemenet = 'Csak az NLP projekten dolgozom' )

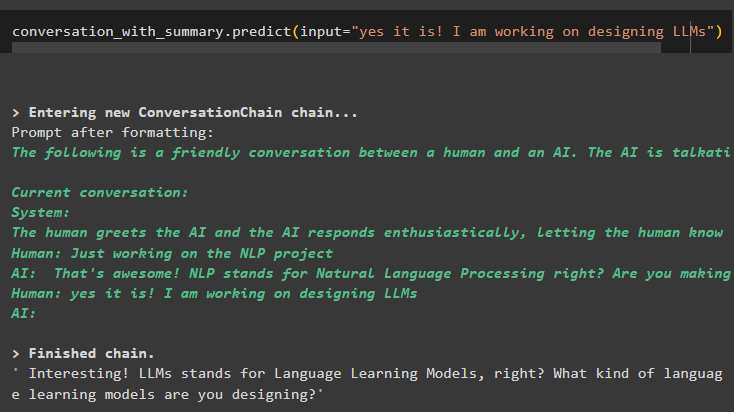

Használja a modell kimenetét, és adjon hozzá további adatokat a puffermemóriában lévő üzenetek segítségével, és jelenítse meg az összefoglalót:

beszélgetés_összefoglalóval. megjósolni ( bemenet = 'Igen, az! LLM-ek tervezésén dolgozom' )

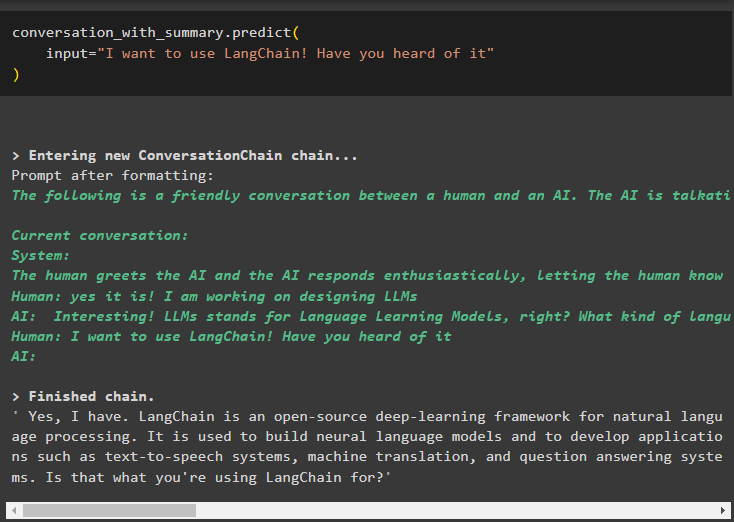

Az összefoglaló szerint a kimenet könnyen érthető és emberbarátabb lesz, és alkalmasabb chatbotoknak:

beszélgetés_összefoglalóval. megjósolni (bemenet = 'A LangChaint akarom használni! Hallottál róla?'

)

Ez minden a LangChain beszélgetés-összefoglaló pufferének használatáról szól.

Következtetés

A beszélgetés-összefoglaló puffermemória használatához a LangChainben egyszerűen telepítse a modulokat vagy keretrendszereket a szükséges könyvtárak beszerzéséhez. A könyvtárak importálása után állítsa össze az LLM-eket vagy chatbotokat a ConverstaionSummaryBufferMemory() függvény használatával a beszélgetés összefoglalójának lekéréséhez. A puffermemória korlátozza a memóriában tárolt üzenetek számát az összegzés kinyerésére. Ez a bejegyzés részletesen bemutatja a beszélgetés-összefoglaló puffermemória használatának folyamatát a LangChainben.