A LangChain a Natural Language Processing vagy NLP tartomány alkalmazásának keretrendszere, amellyel emberszerű nyelveken lehet modelleket készíteni. Ezeket a modelleket az emberek használhatják arra, hogy válaszokat kapjanak a modelltől, vagy beszélgethessenek, mint bármely más ember. A LangChaint láncok építésére használják úgy, hogy a beszélgetés minden mondatát eltárolják, és kontextusként használva tovább kommunikálnak egymással.

Ez a bejegyzés bemutatja az LLM és az LLMChain felépítésének folyamatát a LangChainben.

Hogyan építsünk LLM-et és LLMChaint a LangChainben?

Az LLM és az LLMChain létrehozásához a LangChainben egyszerűen hajtsa végre a felsorolt lépéseket:

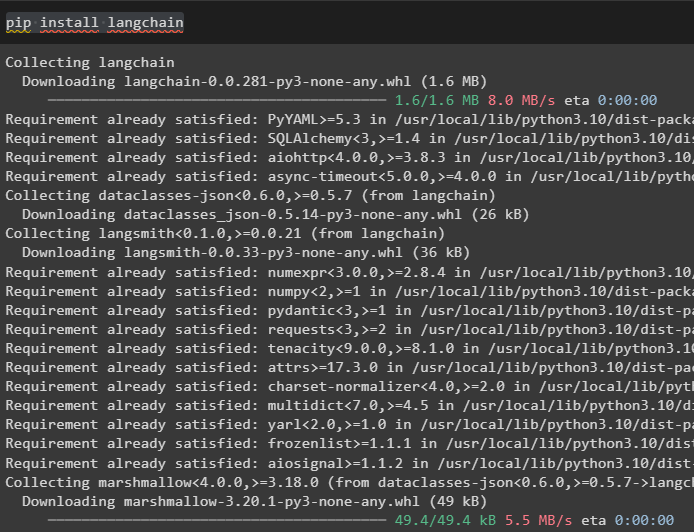

1. lépés: Modulok telepítése

Először telepítse a LangChain modult, hogy a könyvtárait LLM-ek és LLMChain építéséhez használja:

pip install langchain

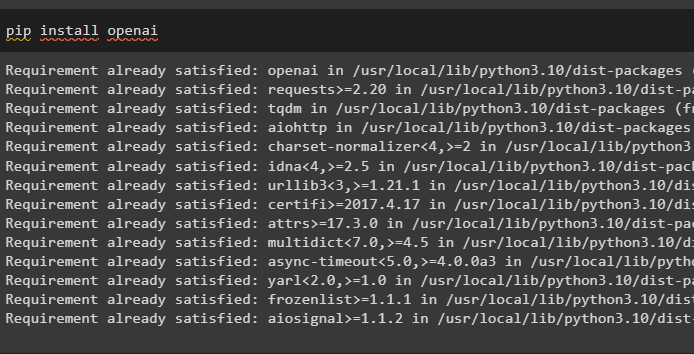

Az LLM-ek felépítéséhez szükséges másik modul az OpenAI, és a pip paranccsal telepíthető:

pip install openai

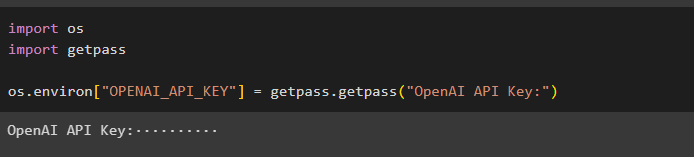

2. lépés: Környezet beállítása

Állítson be egy környezetet a környezetéből származó OpenAI API-kulcs használatával:

importálni minketimport getpassos.environ['OPENAI_API_KEY'] = getpass.getpass('OpenAI API kulcs:')

1. példa: LLM-ek létrehozása LangChain használatával

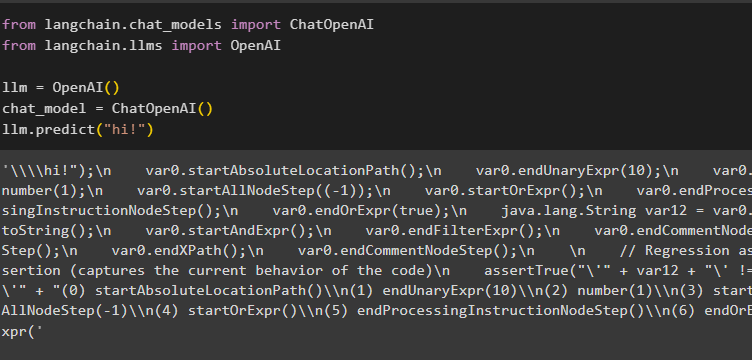

Az első példa a Large Language Models létrehozása LangChain használatával OpenAI és ChatOpenAI könyvtárak importálásával és az llm() függvény használatával:

1. lépés: Az LLM csevegési modell használata

Importáljon OpenAI és ChatOpenAI modulokat egy egyszerű LLM létrehozásához OpenAI környezettel a LangChainből:

a langchain.chat_models webhelyről importálja a ChatOpenAI-ta langchain.llms-ből importálja az OpenAI-t

llm = OpenAI()

chat_model = ChatOpenAI()

llm.predict('szia!')

A modell „szia” választ adott, ahogy az alábbi képernyőképen látható:

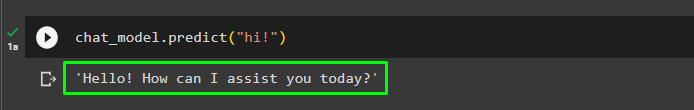

A chat_model előrejelzése () függvénye arra szolgál, hogy megkapja a választ vagy a választ a modellből:

chat_model.predict('szia!')A kimenet azt mutatja, hogy a modell a lekérdezést kérő felhasználó rendelkezésére áll:

2. lépés: A szöveges lekérdezés használata

A felhasználó válaszokat is kaphat a modellből, ha a szöveges változóban megadja a teljes mondatot:

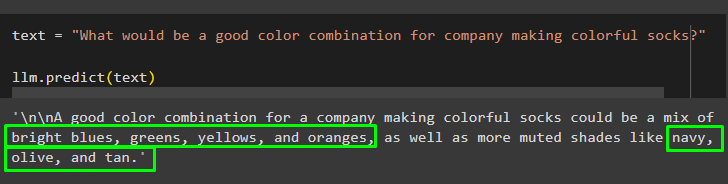

text = 'Mi lenne a jó cégnév egy színes zoknikat gyártó cégnek?'llm.predict(text)

A modell több színkombinációt is megjelenített a színes zoknikhoz:

Szerezze meg a részletes választ a modelltől a predikció() függvény segítségével a zokni színkombinációival:

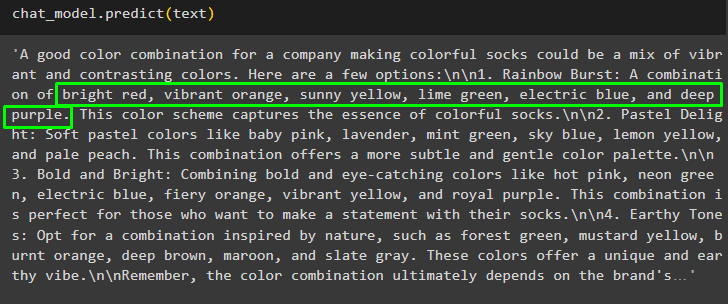

chat_model.predict(text)

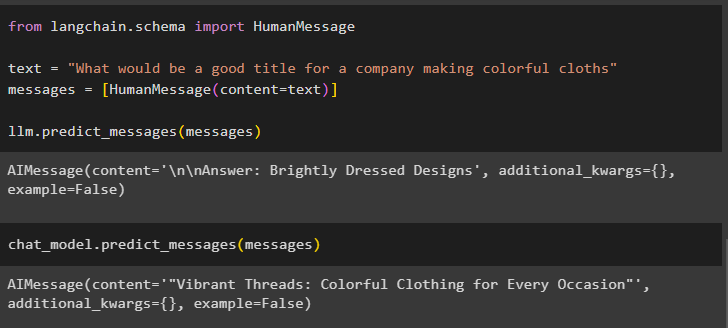

3. lépés: Szöveg használata tartalommal

A felhasználó egy kis magyarázattal kaphatja meg a választ:

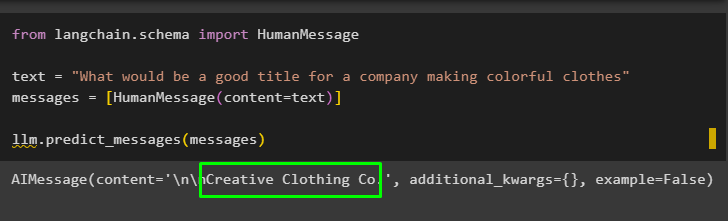

innen: langchain.schema import HumanMessagetext = 'Mi lenne a jó cím egy színes ruhákat gyártó cégnek'

üzenetek = [HumanMessage(content=text)]

llm.predict_messages(üzenetek)

A modell létrehozta a cég címét, amely a „Creative Clothing Co”:

Előre jelezze az üzenetet, hogy magyarázattal együtt megkapja a választ a cég címére is:

chat_model.predict_messages(üzenetek)

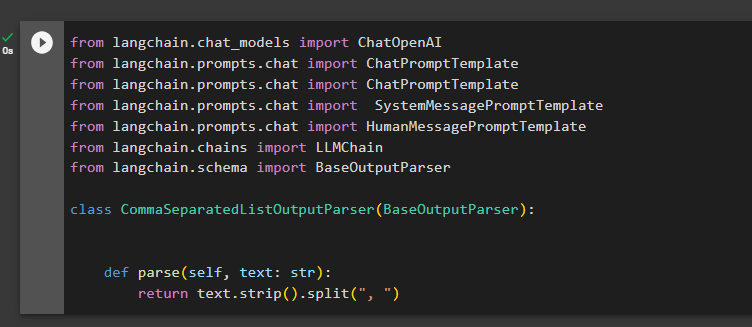

2. példa: LLMChain készítése LangChain használatával

Útmutatónk második példája az LLMChain-t építi fel, hogy a modell emberi interakciós formátumba kerüljön az előző példa összes lépésének kombinálásához:

a langchain.chat_models webhelyről importálja a ChatOpenAI-ta langchain.prompts.chat importálásáról ChatPromptTemplate

a langchain.prompts.chat importálása ChatPromptTemplate

innen: langchain.prompts.chat import

innen: langchain.chains import LLMChain

innen: langchain.schema import BaseOutputParserclass CommaSeparatedListOutputParser(BaseOutputParser):

def parse(self, text: str):

return text.strip().split(', ')

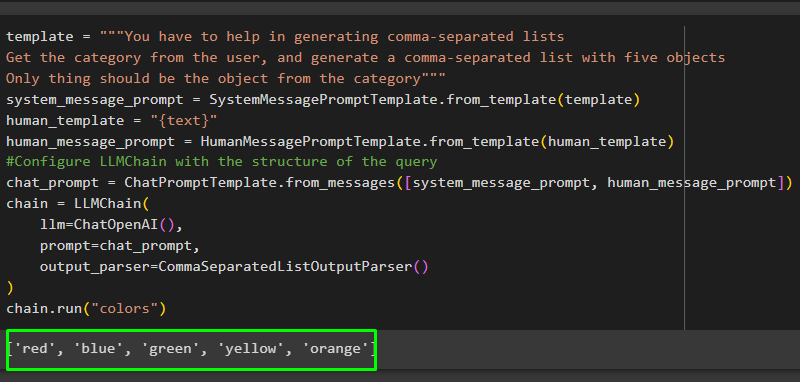

Építse meg a csevegési modell sablonját a működésének részletes leírásával, majd készítse el az LLM-t, a kimeneti elemzőt és a chat_prompt könyvtárat tartalmazó LLMChain() függvényt:

template = '''Segítségre van szüksége a vesszővel elválasztott listák létrehozásábanKérje le a kategóriát a felhasználótól, és hozzon létre egy vesszővel elválasztott listát öt objektumból

Csak a ''' kategóriába tartozó objektum lehet

system_message_prompt = SystemMessagePromptTemplate.from_template(template)

human_template = '{szöveg}'

human_message_prompt = HumanMessagePromptTemplate.from_template(human_template)

#Állítsa be az LLMChaint a lekérdezés szerkezetével

chat_prompt = ChatPromptTemplate.from_messages([system_message_prompt, human_message_prompt])

lánc = LLMchain(

llm=ChatOpenAI(),

prompt=chat_prompt,

output_parser=CommaSeparatedListOutputParser()

)

chain.run('színek')

A modell a színlistával megadta a választ, mivel a kategória csak 5, a promptban megadott objektumot tartalmazhat:

Ez az egész az LLM és az LLMChain felépítéséről szól a LangChainben.

Következtetés

Az LLM és az LLMChain LangChain használatával történő felépítéséhez egyszerűen telepítse a LangChain és az OpenAI modulokat, és állítson be egy környezetet az API-kulcsával. Ezt követően készítse el az LLM-modellt a chat_model használatával, miután létrehozta a prompt sablont egy teljes csevegés egyetlen lekérdezéséhez. Az LLMChain-t arra használják, hogy láncokat építsenek fel a beszélgetés összes megfigyeléséből, és használják őket az interakció kontextusaként. Ez a bejegyzés az LLM és az LLMChain felépítésének folyamatát mutatja be a LangChain keretrendszer használatával.