A Machine Learning modellek alkalmazhatóságát és használhatóságát adatokon tesztelik. A tesztek megbízhatósága nagymértékben függ azon adatok mennyiségétől és minőségétől, amelyekre ezeket a modelleket alkalmazzák. Önmagában egy teljes feladat egy megfelelően nagy adatkészlet létrehozása, beszerzése és tisztítása, hogy tesztelje a „ Természetes nyelvi feldolgozás (NLP) ” Gépi tanulási modell.

A Hugging Face erre kínál ügyes megoldást kivételesen nagy adatkészlet-könyvtárával, amelyből választhat, és megtalálhatja az igényeinek tökéletesen megfelelőt. Itt megmutatjuk, hogyan találhatja meg az ideális adatkészletet, és hogyan készítheti fel a modell megfelelő tesztelésére.

Hogyan használjuk az átölelő arc adatkészleteket?

Megmutatjuk, hogyan kell használni a Hugging Face Dataseteket a „ TinyStories ” Adatkészlet Hugging Face-ből.

Példa

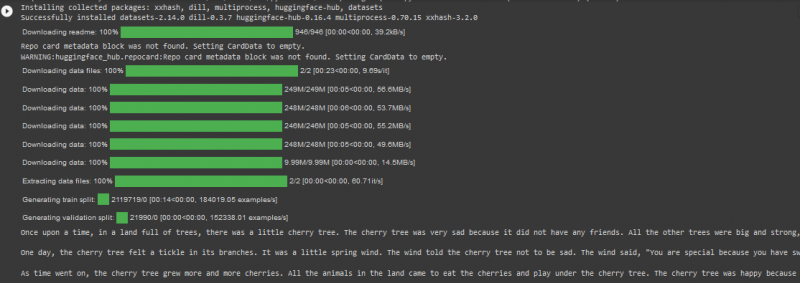

A TinyStories Dataset több mint 2 millió adatsort tartalmaz a vonatfelosztásban, és több mint 2 ezer letöltése van a Hugging Face platformon. A Google Colab alábbi kódjában fogjuk használni:

! csipog telepítés transzformátorok

! csipog telepítés adathalmazok

adatkészletekből import load_dataset

adatkészlet = load_dataset ( 'roneneldan/TinyStories' )

TinyStories_Story = 3

example_string = adatkészlet [ 'vonat' ] [ TinyStories_Story ] [ 'szöveg' ]

nyomtatás ( példa_karakterlánc )

Ebben a kódban vegye figyelembe az alábbi lépéseket:

01. lépés : Az első lépés a „ telepítés ” transzformátorok adatkészleteiből.

02. lépés : Ezután importálja a szükséges adatkészletet, ' TinyStories ” a projektjébe.

03. lépés : Ezután töltse be a kiválasztott adatkészletet a „ load_dataset() ” funkciót.

04. lépés : Most megadjuk a kívánt történetszámot a TinyStories adatkészletből. A kódpéldánkban a 03-as számot adtuk meg.

05. lépés : Végül a „print()” metódust fogjuk használni a kimenet megjelenítésére.

Kimenet

Jegyzet: A kód és a kimenet közvetlenül a Google Colabban is megtekinthető .

Következtetés

' Hugging Face adatkészletek ” hihetetlenül hatékonyvá teszik a felhasználók számára a Machine Learning modelljeik tesztelését, miközben közvetlenül importálnak nagy adatkészleteket online könyvtárukból. Ennek eredményeként az NLP-algoritmusok alkalmazása könnyebbé és gyorsabbá vált, mivel a programozók tesztelhetik projektjeiket egy minőségi és mennyiségi adatkészlet alapján.